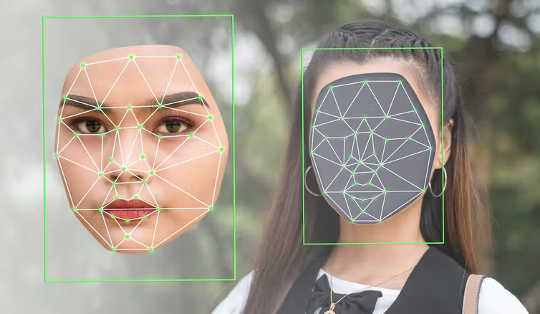

可以生产深度伪造的技术已广泛使用。 (存在Shutterstock)

三月初,一个 乌克兰总统泽连斯基的篡改视频被传播. 在其中,一个数字生成的泽连斯基告诉乌克兰国民军投降。 该视频在网上流传,但很快被揭穿为深度伪造——一种使用人工智能制作的超现实但伪造和操纵的视频。

虽然俄罗斯的虚假信息似乎影响有限,但这个令人震惊的例子说明了深度造假的潜在后果。

然而,deepfakes 已成功用于辅助技术。 例如, 患有帕金森病的人可以使用语音克隆进行交流.

Deepfakes 用于教育:总部位于爱尔兰的语音合成公司 CereProc 为 John F. Kennedy 创建了合成语音, 让他起死回生,发表他的历史演讲.

然而,每一枚硬币都有两个面。 Deepfake 可以是超现实的,并且 人眼基本无法察觉.

因此,相同的语音克隆技术可用于网络钓鱼、诽谤和勒索。 当故意使用深度伪造来重塑舆论、煽动社会冲突和操纵选举时,它们有可能破坏民主。

华盛顿大学的研究人员制作了一个深度伪造的巴拉克奥巴马。

造成混乱

Deepfakes 基于被称为 生成对抗网络 其中两种算法相互训练以产生图像。

虽然深度造假背后的技术听起来很复杂,但制作一个却是一件简单的事情。 有许多在线应用程序,例如 换脸 和 ZAO 深度交换 可以在几分钟内产生深度伪造。

Google Colaboratory — 多种编程语言代码的在线存储库 — 包括以下代码示例 可用于生成虚假图像和视频. 使用这种易于访问的软件,很容易看出普通用户如何在没有意识到潜在安全风险的情况下对 deepfakes 造成严重破坏。

换脸应用程序和在线服务的普及,例如 深情怀旧 展示普通大众可以如何快速和广泛地采用深度伪造。 2019年, 检测到大约 15,000 个使用 deepfakes 的视频. 而且这个数字预计还会增加。

Deepfakes 是虚假宣传活动的完美工具,因为它们会产生可信的假新闻,需要时间来揭穿。 与此同时,深度造假所造成的损害——尤其是那些影响人们声誉的——往往是持久且不可逆转的。

对于任何想要以最小的努力创建令人信服的深度赝品的人来说,DeepSwap 是一个不错的选择。 ??t;a href="https://twitter.com/hashtag/DeepSwap?src=hash&ref_src=twsrc%5Etfw">#DeepSwap #换脸 #DeepFake #FaceApp #重塑 #审查 #Reviews #人工智能 #AI #Tech #技术 #科技新闻 #科技新闻 #中东和北非 #TechMGZNhttps://t.co/A2Cbp02sH1

— 科技杂志 (@TechMGZN) 2022 年 5 月 4 日

眼见为实?

深度造假最危险的后果可能是它们如何让自己在政治运动中传播虚假信息。

当唐纳德特朗普将任何令人不快的媒体报道称为“假新闻。” 通过指责他的批评者传播假新闻,特朗普能够利用错误信息来捍卫他的不法行为并作为宣传工具。

特朗普的策略使他能够在充满不信任和虚假信息的环境中保持支持,他声称“真实的事件和故事是假新闻或深度伪造设立的区域办事处外,我们在美国也开设了办事处,以便我们为当地客户提供更多的支持。“

当局和媒体的公信力正在受到损害,造成不信任的气氛。 随着深度伪造的不断增加,政客们可以轻松地否认任何新出现的丑闻的罪责。 如果有人否认,如何确认视频中某人的身份?

然而,打击虚假信息一直是民主国家面临的挑战,因为它们试图维护言论自由。 通过让人们验证信息,人与人工智能的伙伴关系可以帮助应对日益上升的深度伪造风险。 还可以考虑引入新的立法或适用现有法律,以惩罚伪造信息和冒充他人的深度造假者。

国际和国家政府、私营公司和其他组织的多学科方法对于保护民主社会免受虚假信息的侵害都至关重要。![]()

关于作者

李思峰, 研究助理, 情报学系, 麦吉尔大学 和 本杰明 CM 冯,教授和加拿大网络安全数据挖掘研究主席, 麦吉尔大学